Inicio de curso

La inscripción para este programa formativo está abierta durante el presente año.

La inscripción para este programa formativo está abierta durante el presente año.

225 Horas, 9 Créditos ECTS

Tendrás 6 meses de acceso libre al Campus Virtual y todos sus contenidos E-learning.

Este programa cuenta con certificación universitaria, válido para bolsas y oposiciones. Consulta siempre las bases específicas de tu Comunidad Autónoma.

El Curso Universitario de Especialización en Big Data para Ingenierías es una formación académica diseñada para proporcionar a los estudiantes los conocimientos y habilidades necesarios para desarrollarse en el campo del análisis y gestión de grandes volúmenes de datos. Este curso se centra en la aplicación de técnicas y herramientas específicas del Big Data para resolver problemas reales en el ámbito de las ingenierías.

Además, los estudiantes adquirirán habilidades fundamentales en estadística y análisis de datos que les permitirán comprender y aplicar técnicas avanzadas de minería de datos y aprendizaje automático. A lo largo del curso, también se abordarán temas clave como la visualización de datos y la seguridad en el procesamiento de big data.

El programa de este curso incluye una combinación equilibrada de teoría y práctica. Los participantes tendrán la oportunidad de trabajar en casos de estudio y proyectos reales, aplicando los conocimientos adquiridos a situaciones del mundo real. Además, contarán con el apoyo de profesores expertos y recibirán una constante retroalimentación para mejorar sus habilidades y conocimientos.

Al finalizar el Curso Universitario de Especialización en Big Data para Ingenierías, los estudiantes estarán preparados para enfrentar los desafíos y aprovechar las oportunidades que el análisis de big data ofrece en el ámbito de las ingenierías. Su perfil profesional se verá fortalecido y tendrán las competencias necesarias para trabajar en empresas y organizaciones que requieran expertos en el manejo y análisis de grandes volúmenes de datos.

Nuestros programas académicos cuentan con la acreditación universitaria otorgada por European University Gasteiz (EUNEIZ), una institución de renombre en el ámbito educativo europeo. Esta acreditación asegura que los contenidos y la metodología de enseñanza de nuestros Cursos, Expertos, Especialistas y Máster de Formación Permanente cumplen con los estándares académicos y profesionales establecidos por EUNEIZ.

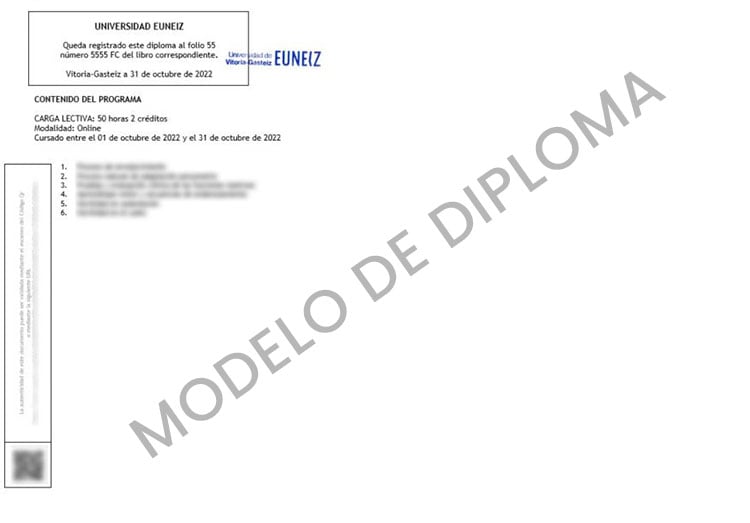

Los diplomas emitidos bajo la acreditación de la Universidad Vitoria-Gasteiz confirman que el estudiante ha completado satisfactoriamente un programa de estudio que cumple con los criterios de calidad educativa europea. Además, cada diploma cuenta con la firma del Rector y un Código de Verificación único. Al acceder al enlace proporcionado en el diploma e introducir este código, los estudiantes pueden verificar fácilmente la autenticidad y la validez académica del título obtenido.

El Curso Universitario de Especialización en Big Data para Ingenierías está especialmente diseñado para estudiantes con un perfil académico y profesional en el ámbito de las ingenierías y que deseen adquirir conocimientos especializados en Big Data. Los destinatarios de esta formación incluyen, pero no se limitan a:

Los alumnos serán incluidos en la edición del mes en la cual finalicen su formación, siempre y cuando cumpla los plazos mínimos, estos están establecidos por el reglamento de educación en 2 Créditos ECTS por cada semana.

Si necesitas más información sobre las ediciones de este Curso Online, no dudes en ponerte en contacto con nosotros.

La metodología que se desarrollará en el siguiente evento académico, será en línea de una forma E-learning incorporada dentro de un Campus Académico Online y Didáctico con las últimas innovaciones tecnológicas, para que este se adapte su resolución al dispositivo desde el cual se acceda.

Nuestro Campus Virtual estará disponible las 24 horas del día, los 7 días de la semana, siendo accesible desde cualquier ubicación del mundo con acceso a la red.

Una vez el alumno se inscriba, recibirá los datos de acceso a su Plataforma de estudio, junto con los datos de su profesor e instructor docente, el cual le ayudará con todas las dudas que puedan plantearse durante el programa formativo, podrá contactar con su profesor por la mensajería directa del campus o vía email.

La evaluación de nuestro curso online se estructura en dos partes esenciales, diseñadas para medir de manera integral los conocimientos y competencias adquiridas por los participantes.

Para aprobar el curso y recibir la certificación correspondiente, los participantes deben obtener una puntuación superior al 50% en ambas partes de la evaluación. Este umbral asegura que solo aquellos que hayan asimilado efectivamente los contenidos y desarrollado las competencias necesarias serán acreditados.

En este módulo final, se te invita a emprender un ejercicio de desarrollo enfocado en una de las temáticas que has estudiado previamente o alguna temática de innovación relacionada directamente con Big Data para Ingenierías. Durante la realización de este ejercicio, tendrás a tu disposición en el Campus Virtual una serie de documentos que funcionarán como guías y ejemplos para ayudarte en tu tarea. Más importante aún, contarás con el apoyo constante y sincrónico de nuestro equipo docente, quienes estarán disponibles para asistirte y resolver cualquier duda o inquietud que pueda surgir mientras avanzas en tu proyecto. Este ejercicio representa una oportunidad valiosa para aplicar y consolidar los conocimientos adquiridos a lo largo del curso.

Universidad de Vitoria-Gasteiz garantiza la calidad y validez de la formación impartida en colaboración con Universal Formación.

Una vez finalice su programa formativo le será expedido el diploma universitario correspondiente. A continuación se muestra un ejemplo de formato del título emitido.

La Universidad de Vitoria-Gasteiz (EUNEIZ) es una nueva universidad privada, oficialmente reconocida según la Ley 8/2021, de 11 de noviembre (BOE – BOPV). EUNEIZ se encuentra plenamente integrada en el Sistema Universitario Vasco y se dedica a brindar educación superior a través de la docencia, investigación, formación continua y la transferencia de conocimiento y tecnología.

La Universidad de Vitoria-Gasteiz y Universal Formación, buscamos potenciar aún más nuestra oferta educativa al proporcionar programas formativos online de alta calidad y acreditados universitariamente. Esta alianza representa una oportunidad única para nuestros estudiantes y para el avance de la educación en línea en un entorno cada vez más digital y globalizado.

Una vez finalice su programa formativo le será expedido el Diploma de la Universidad de Vitoria-Gasteiz, este documento que le mostramos a continuación sería su modelo:

¿Tienes alguna duda?

Déjanos tus datos y un asesor te contactará para resolver todas tus dudas sobre Curso Universitario de Especialización en Big Data para Ingenierías sin ningún compromiso.

Curso Universitario de Especialización en Big Data para Ingenierías

¡Solicitud enviada!

Un asesor se pondrá en contacto contigo en menos de 24 horas.

Cupón de descuento para tu matrícula